Autore

Indice

- Introduzione: Ai Art e intelligenza artificiale: GAN

- Percezione, interazione, ottimizzazione

- Il rovescio della medaglia. Come convivere con l’AI? Rischi e prospettive

↓ download pdf

S&F_n. 29_2023

Abstract

How Technology is Changing our Lives. Some Remarks starting out from contemporary Art

This short essay aims to explore how new technologies are changing and shaping our perception of ourselves, others and our being in the world. This questioning will have contemporary art as its privileged field of research. Understanding art as a purely human activity and observing contemporary art, it is possible to see how various artists are exploring precisely this change through the use of different artificial intelligence technologies in their works, reflecting on questions of identity, perception, and communication in the digital age. The idea behind this short essay is that the combination of art and science in contemporary art proves to be a particularly fertile field of research, comparable to a kind of seismograph that can detect changes in the relationship between technology and human experience. The first section will be an introductory overview of the main artificial intelligence models used in contemporary art. The second section will examine how their application influences the way we perceive the world, ourselves and others, while at the same time reflecting on what it entails in the process of creating a work and how it changes the role of the artist and the spectator. Finally, the last section will attempt to explore the problems and risks associated with the use of artificial intelligence. The final aim of this short essay is therefore to open up new pathways of reflection and broaden the contemporary debate on an urgent and highly topical issue.

Questo saggio si innesta all’interno di una ricerca più ampia che mette insieme la riflessione sulla filosofia dell’arte, la tecnologia e le sue implicazioni etiche ed estetiche, nella convinzione che l’arte ma ancor più, l’estetica sia un terreno di ricerca fertile per comprendere l’umano e la direzione verso cui ci si sta dirigendo, proprio perché si configura fin dalla sua nascita come territorio di confine che ha sempre cercato di dialogare con diverse discipline (antropologia; sociologia, scienze cognitive, psicologia, ecc).

- Introduzione: Ai Art e intelligenza artificiale: GAN

L’Ai Art, ovvero l’arte prodotta mediante l’utilizzo dell’intelligenza artificiale[1], è un fenomeno artistico piuttosto recente[2]. Sono passati infatti poco meno di dieci anni quando nel 2014 il team di Ian Goodfellow dell’Università di Montréal mette a punto il processo chiamato GAN, ovvero, Generative Adversarial Network (rete generativa avversaria) che consiste in due reti neurali (generator e discriminator) tra loro in competizione con lo scopo di generare dati (suoni, immagini, testi).

Comprendere il funzionamento delle GAN è essenziale al fine di di poter svolgere una riflessione critica sul rapporto fra arte e tecnologia ma soprattutto fra tecnologia ed esperienza umana.

Per ragioni di brevità descriverò a grandi linee il funzionamento base di una GAN[3].

Una GAN è un tipo di rete neurale artificiale composta da due parti: un generatore e un discriminatore. Il generatore ha il compito di generare dati, mentre il discriminatore ha il compito di distinguere tra i dati generati dal generatore e i dati reali.

Il funzionamento di una GAN può essere diviso in tre fasi: la fase di addestramento del discriminatore, la fase di addestramento del generatore e la fase di utilizzo del modello.

Durante la fase di addestramento del discriminatore, il modello viene alimentato con un set di dati di addestramento che contiene sia dati reali che dati generati dal generatore. Il discriminatore è addestrato per distinguere tra i due tipi di dati e assegnare loro una probabilità di essere reali o generati.

Durante la fase di addestramento del generatore, il modello genera dati a partire da un rumore casuale di input. L'obiettivo del generatore è di generare dati che possano ingannare il discriminatore facendogli credere che siano dati reali.

La fase di utilizzo del modello consiste nel far passare il rumore casuale di input attraverso il generatore per generare dati, che vengono poi passati al discriminatore per determinare se sono reali o generati. In pratica, il modello viene utilizzato per generare dati artificiali, come immagini o testo, che sono difficili da distinguere dai dati reali.

Una delle principali applicazioni delle GAN è la generazione di immagini foto realistiche a partire da dati non strutturati, come ad esempio testo. Le GAN possono essere utilizzate anche per la generazione di suoni, video e molto altro.

Il rumore causale è un elemento cruciale del funzionamento delle GAN. Esso viene introdotto nella rete neurale generativa come input casuale durante il processo di generazione di immagini o dati sintetici. Il rumore casuale ha lo scopo di aumentare la varietà delle immagini generate e di impedire che la rete neurale generativa impari a generare sempre le stesse immagini. In altre parole, l'aggiunta di rumore casuale alla rete neurale generativa consente di creare immagini sintetiche sempre diverse. Il rumore casuale può essere introdotto nella rete neurale generativa in vari modi. Ad esempio, può essere generato da una distribuzione Gaussiana o da una distribuzione uniforme. In ogni caso, l'importante è che il rumore casuale sia sempre presente durante il processo di generazione delle immagini sintetiche. In pratica, il rumore casuale viene spesso combinato con altre informazioni, come ad esempio le etichette di classe, per produrre immagini sintetiche più complesse e realistiche. Se stiamo generando immagini di volti umani, possiamo combinare il rumore casuale con informazioni come la forma del viso, la forma degli occhi e della bocca, la posizione delle orecchie, ecc. Questo allo scopo di estendere il campo d’azione del generatore affinché possa esplorare un ventaglio sempre più ampio di soluzioni e generare immagini sintetiche sempre più realistiche e variegate impedendo quindi che la rete generativa impari a creare sempre le stesse immagini.

Le diverse varianti delle GAN DCGAN (Deep Convolutional Generative Adversarial Network); CycleGAN; StyleGAN; Pix2Pix; DALLl·E, Midjourney si differenziano per l'architettura di rete, la funzione obiettivo e il tipo di dati di input utilizzati, e sono state sviluppate per applicazioni specifiche di generazione di immagini, ma hanno in comune l'idea di utilizzare una rete generativa e una discriminativa.

La questione più rilevante per il tema di questo breve articolo è un altro. In tutte le GAN utilizzate nell'arte contemporanea, c'è una parte autonoma svolta dall'AI che sfugge al controllo diretto dell'artista. Ciò accade perché le GAN utilizzano una rete neurale artificiale per generare immagini o altro contenuto creativo, e questa rete è in grado di apprendere autonomamente le caratteristiche del dataset di partenza e generare nuovi output sulla base di queste informazioni.

Quest’ultima è una delle questioni principali: l’autonomia dell’AI nel processo di creazione delle opere d’arte corrisponde alla perdita di controllo dell’artista sul risultato finale dell’opera.

- Percezione, interazione, ottimizzazione

Negli ultimi mesi si è discusso ampiamente sull’utilizzo dell'AI in tutti i campi, dalla scrittura di canzoni e saggi alle auto senza conducente, dai terapisti alle chatbox e allo sviluppo della medicina.

Questa discussione si è accesa recentemente grazie all’artista tedesco Boris Eldagsen.

Con l’opera intitolata “Pseudomnesia: The Electrician”[4], Eldagsen ha vinto il premio “categoria creativa” aperta del Sony World Photography Award 2023. Tuttavia l’artista ha rifiutato il premio affermando che le immagini create con l’AI non dovrebbero competere con quelle fotografiche. «Si tratta di entità differenti. L’AI non è fotografia. Per tale ragione non accetto il premio»[5]. Lo scopo di Eldagsen era quello di aprire un dibattito sull’utilizzo dell’AI nella fotografia.

Nei mesi successivi al rifiuto del premio il fotografo tedesco ha infatti organizzato diversi eventi per fare chiarezza su cosa siano le immagini create con l’AI. Il 21 Aprile arriva la risposta sulla pagina profilo Facebook: Promptography. Questo termine è stato suggerito a Eldagsen dal fotografo peruviano Christian Vinces che egli cita sul suo sito ringraziandolo e ringraziando anche «tutto il mondo fotografico per aver partecipato al dibattito e aver trasformato i miei piccoli post su facebook e insta in una discussione mondiale!»[6]

Il gesto del fotografo, una vera e propria provocazione, ha delle implicazioni molto più profonde che certamente riguardano il futuro della fotografia e degli artisti ma costituisce altresì un’occasione di riflessione su come la tecnologia influenzi la nostra percezione della realtà.

La sua opera ha infatti chiaramente mostrato come anche fotografi esperti e esperti d'arte possano essere ingannati dall’AI. Fino a poco tempo fa questa distinzione risultava abbastanza evidente. Nelle immagini generate sinteticamente si potevano cogliere facilmente alcuni difetti, come ad esempio: arti e proporzioni non realistiche; espressioni facciali innaturali o problemi con la consistenza della texture.

A oggi l’implementazione costante delle AI rende questa distinzione sempre meno possibile. Attraverso le GAN gli artisti possono ora esplorare nuove forme e combinazioni di colori, creando immagini che sfidano la percezione umana della realtà. Ancora, le GAN consentono agli artisti di creare opere d'arte in modo più efficiente e veloce. Prima del loro utilizzo, la creazione di immagini sintetiche richiedeva un lungo e complesso processo di modellazione e rendering. Con l'utilizzo delle GAN, gli artisti possono generare immagini realistiche in modo più rapido e con meno sforzo. Questo può consentire agli artisti di lavorare su progetti più grandi e ambiziosi, o di produrre più opere in un breve periodo di tempo.

L’artista si trova dunque a giocare un ruolo differente rispetto al passato che implica necessariamente un mutamento nella “relazione” tra strumento e artista. Secondo il collettivo Obvious — che paragona lo sviluppo delle GAN alla comparsa della fotografia dell’800 nel mondo dell’arte — le opere computer generated daranno vita a un nuovo movimento artistico creando opere che si evolvono insieme alla tecnologia. Anche l’artista è destinato ad avere un ruolo differente e a evolversi, apprendendo nuove competenze tecnologiche che muteranno la “relazione” fra artista e strumento. «L’artista rimarrà al centro del processo di creazione in quanto portatore del messaggio e dello stile artistico che comunica attraverso le opere da lui create», ciò nondimeno nella relazione con lo strumento l’artista — prosegue il collettivo — «fa un passo indietro quando gli algoritmi entrano in azione. La creazione visiva viene lasciata interamente all’insieme di istruzioni programmate dall’artista, che può soltanto osservare gli elementi visivi che prendono forma»[7].

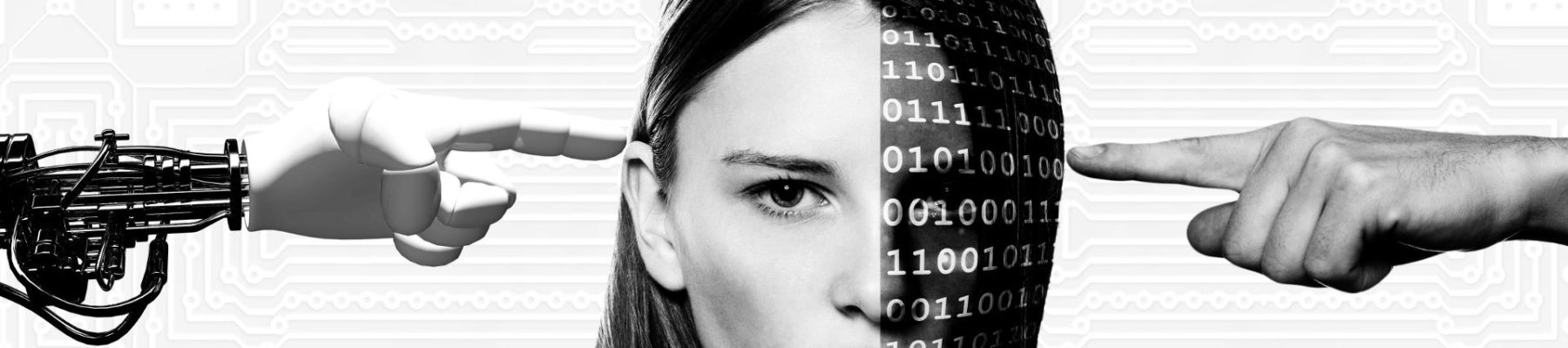

Analogamente anche il rapporto fra spettatore e opera d’arte cambia. Questo è evidente nell’opera “Uncanny Mirror” (2018) dell’artista Mario Klingemann, considerato un pioniere nel campo delle reti neurali, del computer learning e dell'arte creata con l’AI. In questa installazione interattiva il pubblico si trova di fronte a uno schermo che in tempo reale ne analizza i dati biometrici facciali e posturali, generando in stile pittorico un ritratto dello spettatore che rispecchia il modo in cui l’AI lo percepisce. Ogni ritratto — spiega Klingemann — è però il frutto di tutti i volti precedentemente osservati dall’AI.

Lo spettatore cessa quindi di essere un osservatore passivo diventando parte integrante dell’opera. In questo caso particolare diventa il soggetto stesso dell’opera d’arte. «Non solo, se di fronte allo schermo non si trova nessun volto, la macchina continua a imparare, creando animazioni fluide in cui solo occasionalmente compaiono dei volti»[8].

In un mondo in cui la maggior parte delle nostre esperienze passa per uno schermo, il fenomeno dell’AI comporta significative conseguenze nell'ambito della trasformazione tecnologica, influenzando profondamente la nostra interazione con gli strumenti digitali e conseguentemente modellando i nostri comportamenti in svariati settori della vita quotidiana.

La possibilità dell’AI di processare in pochissimo tempo un’enorme mole di dati provenienti da diverse fonti fornisce informazioni utili al fine di prendere decisioni informate cambiando dunque il nostro modo di prendere decisioni. Gli algoritmi di profilazione consentono invece una personalizzazione dell’esperienza dell’utente. Analizzando i dati del comportamento, diviene possibile fornire una personalizzazione dell'esperienza che riflette le preferenze e le abitudini dell'utente. I siti web utilizzano infatti l'AI per mostrare contenuti personalizzati in base ai nostri interessi e alle nostre attività online. Questo processo sta cambiando il modo in cui interagiamo con il mondo online e il modo in cui utilizziamo i servizi digitali. Un altro settore riguarda quello dell’apprendimento. La piattaforma “EDapp” ad esempio utilizza una combinazione di video, presentazioni, quiz interattivi, esercitazioni e forum per fornire un'esperienza di apprendimento coinvolgente e personalizzata. Gli utenti possono lavorare ai loro ritmi e accedere ai materiali di apprendimento quando è più comodo per loro. L’ AI sta cambiando inoltre il modo di lavorare e produrre beni e servizi automatizzando processi ripetitivi, ottimizzando l’efficienza dei processi di produzione consentendo così di abbassare i costi di produzione. Ma è davvero oro tutto ciò che luccica?

- Il rovescio della medaglia. Come convivere con l’AI? Rischi e prospettive

Quando si scrive su un argomento in continua evoluzione come quello dell’AI il rischio è quello che l’articolo potrebbe diventare obsoleto nel giro di pochi mesi o addirittura poche settimane. Nella stesura di questo articolo molte cose sono accadute, come il blocco provvisorio della famosa piattaforma chatGPT in Italia con disposizione immediata del garante della privacy il 30 marzo 2023. La motivazione principale era legata alla raccolta dati degli utenti italiani da parte di OpenAI. Dopo un brevissimo braccio di ferro, chatGPT riapre il 28 aprile del 2023 garantendo più trasparenza e più diritti a utenti europei e non, come si legge nel comunicato ufficiale rilasciato[9]. Il 27 aprile 2023, il “padrino dell’AI” Geoffrey Hinton si dimette da Google per poter parlare liberamente dei rischi connessi all’AI senza danneggiare l’azienda, come riportato nel lungo articolo rilasciato al New York Times[10]. Molte altre cose accadranno durante la stesura di questo articolo che al momento non è possibile prevedere. Ma qui non si tratta di offrire risposte confezionate e pronte all’uso sul futuro di questa rivoluzione tecnologica. Ciò che più conta è porre le domande giuste, con lo scopo di aprire nuovi percorsi di riflessione e ampliare il dibattito contemporaneo su una questione urgente e di cocente attualità. Per tale ragione ritengo che una possibile chiave di lettura sia quella di comprendere in che modo si sia arrivati da un utilizzo della tecnologia che aveva lo scopo di sollevare gli uomini dai lavori più pesanti, a una tecnologia che ora li sottrae ai compiti mentali più impegnativi. In breve: come si è passato dall’utilizzo della tecnologia come strumento ausiliario a un’entità da cui gli individui sono totalmente dipendenti? Cosa è accaduto e cosa comporta? Quali sono le implicazioni etiche, sociali e culturali di questo cambiamento di paradigma?

Le parole pronunciate da Klingemann per la presentazione della sua installazione “Uncanny Mirror” mi pare riassumano in maniera quasi inquietante il rapporto uomo-macchina, non solo in ambito artistico, ma in tutti gli ambiti più sopra menzionati: il pubblico diventa un’interessante banca dati. L’individuo, che lo sappia o meno, diventa a sua volta strumento di uno strumento.

A distanza di poco più di mezzo secolo le parole di Heidegger suonano quasi profetiche: «gli incommensurabili successi dell’inarrestabile sviluppo della tecnica fanno ancor sempre credere che sia l’uomo il signore della tecnica. In verità, invece, egli è il servo di quella potenza»[11].

Secondo quanto emerso dal forum tenutosi il 5 maggio scorso “Tech Economy Hub 2023” del Sole 24 Ore l’Italia, su 27 paesi, si posiziona al 25° posto per diffusione di competenze digitali a causa della mancata consapevolezza e competenza degli strumenti digitali, essenziali per raggiungere l’obiettivo di un’attiva cittadinanza digitale. La strada obbligata passa dall’inclusione si legge nell’articolo del 6 maggio dell’omonima rivista. Inclusione, consapevolezza da raggiungere attraverso la semplificazione di tecnologie evolute. Tale semplificazione coincide con l’effetto frictionless, ovvero senza attrito, descritto dal giornalista del New York Times Kevin Roose come ossessione del settore tecnologico.

Ma come si può rendere semplice una rivoluzione epocale che sta ridisegnando e plasmando le nostre esistenze, i nostri desideri, il nostro modo di pensare, sentire e agire? Come semplificare le implicazioni antropologiche, culturali, etiche e politiche causate dall’applicazione delle diverse AI?

Tutte le applicazioni dell’AI descritte nel precedente paragrafo assumono un significato e una configurazione del tutto differente se lette alla luce del fatto che il database di cui parla Klingemann sono i soggetti, che da persone diventano utenti e che la nuova architettura delle AI è in grado non soltanto di un apprendimento costante che si nutre delle nostre tracce digitali ma altresì di funzionare in maniera autonoma anche senza la supervisione del soggetto.

La semplificazione delle tecnologie evolute non rende conto di tutto questo ma è assolutamente in linea con quello che è il nuovo paradigma dell’AI: quello che conta non è produrre gli algoritmi migliori ma avere sempre più dati. «Il linguaggio della nuova disciplina è oggi quello della statistica e dell’ottimizzazione, e la preoccupazione costante è la quantità e la qualità dei dati»[12].

Essere consapevoli significa rendere coscienti gli individui, che ciò che viene descritto come personalizzazione dell’esperienza dell’utente in realtà risponde a un meccanismo ben collaudato da un gran numero di aziende (Amazon, Facebook, Google) e che ciò che appare come un suggerimento, di un libro, di un video, di una qualsiasi merce, in realtà somiglia più a un meccanismo di circuizione, manipolazione, volto a innescare nuovi desideri senza che il soggetto ne sia davvero consapevole, rendendo tutte le nostre azioni sempre più semplici e automatiche: “Acquista con un click”.

Nell’ambiente digitale le persone diventano utenti. Nonostante molto spesso questi termini vengano usati come sinonimi intercambiabili, si tratta invece di concetti molto differenti e che implicano ricadute di non poco conto tanto sul concetto di identità del soggetto quanto sulle problematiche della gestione del rapporto uomo-macchina. L’utente è infatti privo dei tratti caratteristici della persona, singolarità, coscienza, volontà, morale, valori, creatività, capacità di prendere decisioni etiche e autonome, emozioni ed esperienze che sono alla base della sua costituzione come soggetto e del modo in cui si relazione con il mondo.

L’utente è al contrario è colui che usufruisce di un bene all’interno di un contesto digitale, di una specifica piattaforma attraverso un’identità virtuale definita da un nome, o da un avatar. Le sue azioni e interazioni si svolgono all’interno di un sistema che mette in discussione la capacità del soggetto di agire autonomamente. Nel mondo digitale infatti si viene a creare una nuova forma di dipendenza e passività poiché le scelte degli utenti sono vincolate, limitate, dagli algoritmi della piattaforma di volta in volta utilizzata. Un esempio è quello dei “cookies”, frammenti di dati sugli utenti memorizzati sul computer o su qualunque dispositivo al fine di offrire un’esperienza personale dell’utente. Molto spesso l’accesso a un contenuto digitale dipende o meno dalla loro accettazione. La loro accettazione comporta la condivisione dei nostri dati e la loro memorizzazione. La libertà dell’utente di interagire all’interno del mondo virtuale è dunque vincolata dall’accesso ai suoi dati personali, alla sua privacy. L’essere umano, dotato di autonomia personale, diventa sempre più un elemento passivo all’interno del mondo digitale, in cui le sue scelte sono dettate dai sistemi di raccomandazione delle macchine.

Nella vita quotidiana — «s’insinua il germe di nuove discriminazioni, nasce il cittadino non più libero ma “profilato” prigioniero di meccanismi che non sa o non può controllare»[13].

Ci troviamo di fronte a quello che è stato definito da Cosimo Accoto ne “Il mondo dato” come inconscio tecnologico che si insinua nelle nostre vite in maniera invisibile. Al momento infatti gli algoritmi e i codici software attraverso cui l’AI prende decisioni sulle nostre vite non sono del tutto decifrabili.

Tutto ciò ci pone di fronte a dilemmi etici e morali di non poco conto.

L’essere umano mutatosi in utente è sottoposto a una nuova forma di dipendenza tecnologica che comporta una serie di automatismi dei quali, perlopiù, non è del tutto consapevole, ponendolo di conseguenza in una posizione di passività.

L’autonomia dell’AI nel processo di creazione di un opera computer generated corrisponde come già detto alla perdita di controllo dell’artista sul risultato finale che, come citato più sopra, può solo osservare. Ma cosa accade quando la perdita di controllo concerne decisioni di tipo etico che riguardano la vita delle persone? A chi deve essere attribuita la responsabilità?

La sfida che si tratta di affrontare è quella di trovare un equilibrio tra la dipendenza tecnologica e l’autodeterminazione dell’individuo. Sarà necessaria una regolamentazione etica delle nuove tecnologie in modo tale che non nuocciano all’essere umano.

Al momento il parlamento europeo sta lavorando sull’AI Act volto a garantire uno sviluppo tecnologico etico e incentrato sull’uomo. I deputati hanno già approvato nuove regole di trasparenza e di gestione dei rischi per i sistemi di AI, come si legge sulla pagina del Parlamento Europeo[14]. Ma come si potrà arrivare a una regolamentazione etica che superi gli interessi dei diversi stati? Questo potrà accadere soltanto attraverso un processo lungo e consapevole, e che richiederà come presupposto essenziale non soltanto un allineamento fra i diversi stati ma altresì una stretta collaborazione e contaminazione tra i vari saperi umani.

A oggi dunque la regolamentazione dei sistemi AI è certamente uno scenario possibile per il futuro del nostro rapporto con la tecnologia che non si configuri come mera dipendenza.

Ma potranno mai dell’entità non umane riuscire a mimare la nostra coscienza morale (Gewissen) e non soltanto quella teorica (Bewußtsein). È questo un tema enorme a cui qui posso soltanto accennare.

In attesa di una tale regolamentazione, non possiamo rimanere a osservare il risultato finale.

La convivenza con i sistemi di AI passa da una presa di coscienza critica dell’individuo: «più si impone l’automatismo, più siamo obbligati a non essere noi automatici e a sviluppare la coscienza accanto alla conoscenza»[15]. Soltanto una tale presa di coscienza e resistenza che si oppone alla semplificazione di meccanismi complessi, potrà forse evitare un indebolimento e un offuscamento del pensiero e della stessa facoltà di giudizio dell’essere umano.

[1] D’ora in poi AI.

[2] Di seguito alcune delle più recenti pubblicazioni sul tema: J. Zylinska, AI Art. Machine vision and warped dreams, Open Humanities Press, London 2020 http://openhumanitiespress.org/books/download/Zylinska_2020_AI-Art.pdf (Ultimo accesso: 12/06/2023); A. Barale (a cura di), Arte e intelligenza artificiale. Be my GAN, Jaca book, Milano 2020; L. Manovich, Defining AI Arts: Three Proposals, 2019 http://manovich.net/content/04-projects/107-defining-ai-arts-three-proposals/manovich.defining-ai-arts.2019.pdf (Ultimo accesso: 12/06/2023); R. Baquero, J. Savulescu, Artificial intelligence and the future of art, in «Journal of Medical Ethics», 45, 10, 2019, pp. 675-679; K. Belhajjame, D. Garijo, AI and creativity: A taxonomy of current approaches, in «Information Processing & Management», 58, 3, 2021; S. Colton, Artificial Intelligence and Computational Creativity, in The Oxford Handbook of Computational Creativity, Oxford University Press, Oxford 2021, pp. 483-500; R. Datta, S. Chaudhuri, A. Mukerjee, Creative applications of artificial intelligence in art and design, in «Design Science», 5, 24, 2019; A. Elgammal, B. Liu, M. Elhoseiny, Can AI be creative?, in «Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops», pp. 1693-1702; B. Graham, New media art and the gallery in the digital age, Routledge, London 2019; H. Liao, Y. Li, Artistic creation with artificial intelligence, in «Advances in Mechanical Engineering», 12, 1, 2020; J. McCormack, M. d'Inverno, Computers and creativity, Springer, Berlin 2012; C. Mok, M. Wong, K.H. Lee, Computational art: a review of AI and machine learning in the visual art, in «Cognitive Computation», 13, 3, 2021, pp. 440-463; P.L. Rosin, Computers and creativity: From co-creativity to creativity support, in «Digital Creativity», 29, 2, 2018, pp. 69-82.

[3] Per una spiegazione più dettagliata cfr. https://papers.nips.cc/paper_files/paper/2014/hash/5ca3e9b122f61f8f06494c97b1afccf3-Abstract.html (Ultimo accesso: 12/06/2023).

[4] https://www.eldagsen.com/sony-world-photography-awards-2023/ (Ultimo accesso: 12/06/2023).

[5] https://www.bbc.com/news/entertainment-arts-65296763 (Ultimo accesso: 12/06/2023; trad. mia).

[6] https://www.eldagsen.com/sony-world-photography-awards-2023/ (Ultimo accesso: 12/06/2023; trad. mia).

[7] Obvious, La Famille de Belamy e i Sogni Elettrici di Ukiyo: reinterpretazioni e accelerazioni, in A. Barale (a cura di), Arte e Intelligenza Artificiale. Be my GaN, cit., p. 190.

[8] https://vimeo.com/336559940 (Ultimo accesso: 12/06/2023; trad. mia).

[9] https://www.garanteprivacy.it/home/docweb/-/docweb-display/docweb/9881490 (Ultimo accesso: 12/06/2023).

[10] https://www.nytimes.com/2023/05/01/technology/ai-google-chatbot-engineer-quits-hinton.html (ultimo accesso: 12/06/2023).

[11] M. Heidegger, Filosofia e Cibernetica (1984), tr. it. ETS, Pisa 1988, p. 42.

[12] C. Nello, La scorciatoia. Come le macchine sono diventate intelligenti senza pensare in modo umano, Il Mulino, Bologna 2023, p. 30.

[13] S. Rodotà, Il mondo nella rete, Laterza, Roma-Bari 2017, p. 37.

[14] https://www.europarl.europa.eu/news/it/press-room/20230505IPR84904/ai-act-a-step-closer-to-the-first-rules-on-artificial-intelligence (ultimo accesso: 12/06/2023).

[15] R. Bodei, Dominio e sottomissione. Schiavi, animali, macchine, intelligenza artificiale, Il Mulino, Bologna 2023, p. 419.